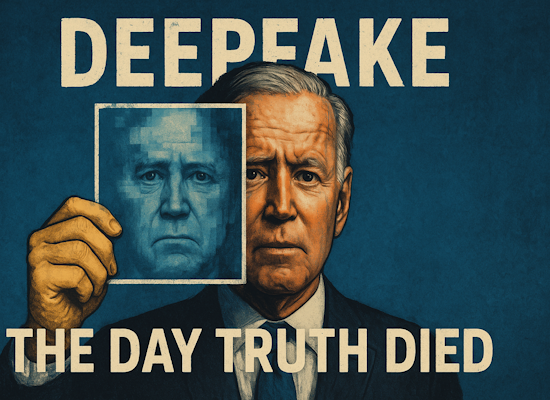

Le jour où la vérité est morte : sommes-nous prêts à l’affronter ?

Alors que les deepfakes et les canulars générés par l’IA deviennent courants, des experts nous mettent en garde : nous pourrions entrer dans une ère de la post-vérité plus vite que nous ne sommes prêts à l’affronter.

Le jour où la vérité est morte ? L’impact des deepfakes

Des millions de personnes ont regardé une vidéo prétendant montrer un chef d’État avouant des crimes de guerre le 6 juillet sur X (anciennement Twitter), Instagram et YouTube — jusqu’à ce qu’elle soit révélée comme un canular quelques heures plus tard.

L’origine ? Un deepfake généré par intelligence artificielle (IA), habilement rédigé, synchronisé avec les mouvements des lèvres, et émotionnellement convaincant.

Bienvenue dans le pays de la nouvelle normalité, où « voir » ne veut plus dire « croire ».

1. La vérité en crise

En 2025, le problème n’est plus simplement la désinformation, mais la persuasion synthétique.

Des experts du MIT et d’Oxford avertissent : le spectateur moyen ne parvient plus à distinguer les textes, les sons ou les vidéos générés par IA de contenus authentiques.

D’après une étude récente de l’Université de Stanford :

Lors d’un test, 72 % des Américains n’ont pas su faire la différence entre un deepfake et une vidéo réelle.

64 % des sondés ont déclaré qu’ils partageraient une information générée par IA si celle-ci correspondait à leurs valeurs.

Les campagnes de désinformation sont devenues des armes : ciblées, automatisées et puissantes.

2. 1er usage massif des deepfakes : la politique

Les deepfakes ne sont pas nouveaux, mais leur dangerosité s’est accrue depuis 2025 :

En mai, un faux discours de Biden a provoqué une panique sur les marchés avant d’être démenti.

En juin, une fausse confession de l’armée israélienne est devenue virale, déclenchant la colère mondiale.

En Inde, des images de manifestations modifiées par IA ont été utilisées contre des opposants politiques.

Ce ne sont pas de simples canulars : ce sont des outils de persuasion capables de manipuler l’opinion, de semer le chaos et de diffuser largement des informations trompeuses.

3. La guerre de l’info sur les réseaux sociaux

Des plateformes comme TikTok, Meta et X affirment lutter contre la désinformation. Mais sont-elles vraiment capables de gagner cette bataille ?

Le nouveau « label contenu IA » de Meta peut être contourné avec de simples ajustements.

X utilise des notes communautaires, mais souvent publiées trop tard.

D’après TechCrunch, TikTok échoue à détecter 43 % des contenus deepfake.

Les équipes de modération ne peuvent pas suivre le rythme des progrès fulgurants de l’IA.

Cela crée un « décalage de détection » : les contenus frauduleux touchent des millions de personnes avant d’être repérés, parfois plusieurs heures plus tard.

4. La confiance s’effondre

La confiance dans les gouvernements, les médias, et même entre citoyens, s’érode en Occident.

« Comment faire confiance à quoi que ce soit, si tout peut être falsifié ? »

— Dr Eliza Tran, psychologue des médias à UC Berkeley

Les conséquences concrètes :

La méfiance envers les élections augmente.

Les campagnes de santé publique font face à des résistances.

Même les images authentiques de guerre sont mises en doute.

Nous sommes au bord d’un moment effrayant où la réalité elle-même devient négociable.

5. Peut-on riposter ?

Il reste heureusement un espoir. Des leaders technologiques et politiques réagissent à cette invasion des deepfakes et à leurs conséquences :

À partir de 2026, le règlement IA de l’UE rendra obligatoire le filigrane des contenus générés par IA.

Google fournit aux journalistes des API de détection des deepfakes.

Adobe progresse avec son Content Authenticity Initiative (CAI) auquel Certificall a décidé d’adhérer via la C2PA (Coalition for Content Provenance and Authenticity).

Des startups développent des détecteurs de deepfake en temps réel pour les journaux télévisés et les visioconférences.

- Le marché de la preuve numérique se développe à travers des prestataires capables de générer facilement des photos et des vidéos certifiées, pour en garantir l’authenticité et même une recevabilité d’un point de vue juridique.

Mais même les meilleurs outils seront inutiles sans une prise de conscience massive du grand public.

6. Implications mondiales

L’IA brouille la frontière entre propagande et documentation dans les vidéos de guerre à Gaza et en Ukraine.

En Afrique, les escroqueries par IA se multiplient.

En Amérique latine, de fausses déclarations politiques influencent les élections.

Aux États-Unis, des théoriciens du complot utilisent les deepfakes pour promouvoir des idéologies extrémistes.

Ce n’est plus un problème technologique : c’est un enjeu de démocratie, de sécurité et de droits humains.

📌 Dernière réflexion

On disait autrefois en anglais : Pics or it didn’t happen, soit « Montre-moi une photo sinon, je considère que ça ne s’est jamais produit ». Une sorte de devise à la Saint-Thomas : je ne crois que ce que je vois (en photo).

En 2025, même une image — ou une vidéo — ne prouve plus rien.

Aujourd’hui, la vérité est une variable mouvante, façonnée par des pixels, des algorithmes et des indicateurs d’engagement, plutôt que par des faits.

Le monde pourrait bien se terminer non dans une explosion spectaculaire…

mais dans un mensonge bien ficelé.

Il est encore temps de sauver la réalité. Avant qu’elle ne devienne, elle aussi, artificielle.

Traduit de la tribune de Tousif Arafat.